Por Chris Davies

Microsoft está lanzando AI para accesibilidad, un programa de $ 25 millones para financiar formas de aprovechar la inteligencia artificial en beneficio de las personas con discapacidades. Anunciado hoy en el Build 2018, el plan de cinco años financiará y apoyará proyectos que usan AI para aliviar el impacto de ser ciego, sordo y más.

Viene inmediatamente después de AI for Earth, que Microsoft anunció el año pasado.Ese programa se centró en cómo se podría implementar la inteligencia artificial para abordar cuestiones como el cambio climático, el desarrollo agrícola y la biodiversidad. Ahora, con más de mil millones de personas con discapacidad en todo el mundo, Microsoft dice que es el turno de AI de influir.

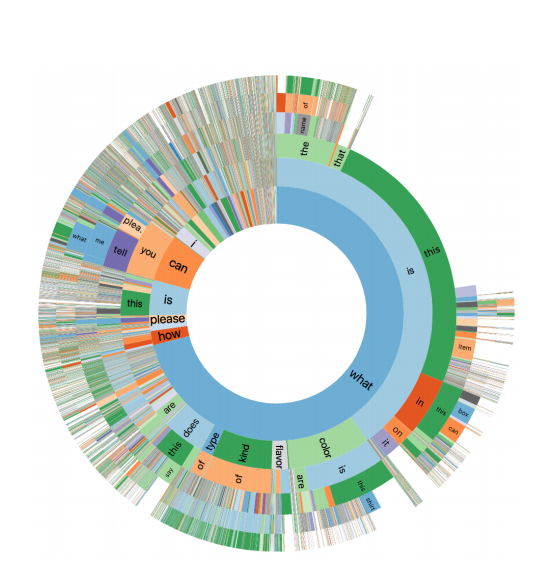

“En Microsoft hemos estado trabajando para soluciones más sólidas como transcripción de voz a texto en tiempo real, servicios de reconocimiento visual y funcionalidad de texto predictivo”, dijo hoy Brad Smith, presidente y director jurídico de Microsoft. “Los avances de la AI como estos ofrecen un enorme potencial al permitir a las personas con discapacidades visuales, auditivas, cognitivas, de aprendizaje, movilidad y salud mental hacer más en tres escenarios específicos: Empleo, Vida moderna y Conexión humana”.

Sin embargo, a pesar de esas mejoras, la mayoría de las personas con discapacidad aún no tiene acceso a las tecnologías de asistencia. De hecho, Smith dice que solo 1 de cada 10 personas lo hace.

Durante los próximos cinco años, AI for Accessibility gastará $ 25 millones para cambiar parte de eso. Inicialmente, otorgará subsidios de tecnología a desarrolladores, universidades, organizaciones no gubernamentales y otros, que adopten “un enfoque de AI” para las tecnologías de asistencia para las personas con discapacidades. Los proyectos más prometedores obtendrán una mayor financiación, además del acceso a los propios expertos en inteligencia artificial de Microsoft.

Finalmente, Microsoft trabajará con los socios para llevar esas mejoras de inteligencia artificial a sus servicios principales. Eso contribuirá a que las tecnologías de asistencia sean lo más accesibles posible.

Ya hay indicios de cómo la AI puede hacer la diferencia. Por ejemplo, los usuarios invidentes confían en el proyecto Seeing AI para narrar el mundo que les rodea. Inicialmente comenzó como un proyecto de investigación en 2016, luego avanzo en una aplicación de teléfono inteligente que se puede descargar libremente. Microsoft Translator, mientras tanto, puede ofrecer subtítulos en tiempo real de las conversaciones para los sordos.

Microsoft está lanzando su sitio AI para accesibilidad hoy. Eso tendrá todos los detalles sobre cómo los proyectos pueden solicitar la inclusión.

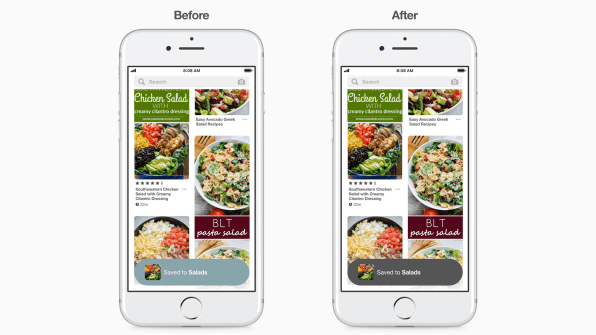

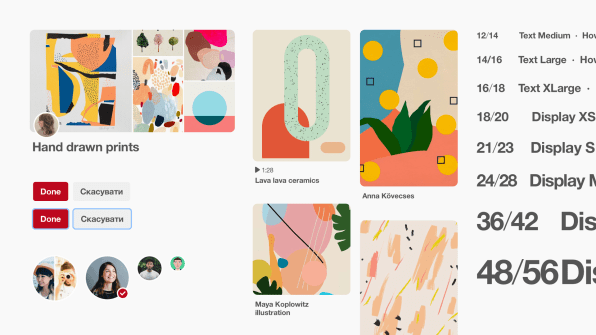

![Indicador de Enfoque [Imagen: cortesía de Pinterest]](https://images.fastcompany.net/image/upload/w_596,c_limit,q_auto:best,f_auto,fl_lossy/wp-cms/uploads/sites/4/2018/04/2-pinterest-just-redesigned-its-app-for-blind-people.jpg)