El software capaz de entender imágenes, sonidos y textos permite crear herramientas que acercan los beneficios de la tecnología a la gente con problemas auditivos y cognitivos como el autismo.

Por Tom Simonite | traducido por Teresa Woods

Las reglas de la Comisión Federal de Comunicaciones de Estados Unidos (FCC, por sus siglas en inglés) obligan a que los canales de televisión ofrezcan subtítulos de los diálogos, los efectos de sonido y las reacciones del público como las risas para los espectadores con problemas de audición. Aunque YouTube no está obligada a tal requisito, ha empezado a cumplirlo gracias a la tecnología de aprendizaje automático de Google.

Desde 2009 YouTube ha empleado software de reconocimiento del habla para generar subtítulos automáticamente, los cuales se usan 15 millones de veces cada día. Ahora acaba de lanzar unos algoritmos que identifican aplausos, risas y música y los señalas dentro de los subtítulos. Y la lista de elementos podría aumentar, ya que el software también puede identificar sonidos como suspiros, ladridos y golpes.

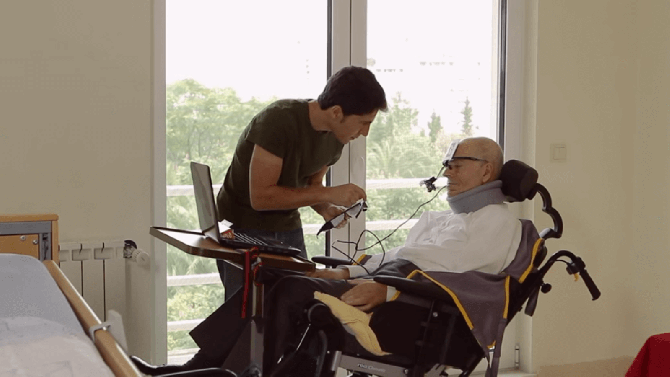

La empresa afirma que las pruebas indican que la prestación mejora significativamente la experiencia de los usuarios con problemas de audición (y de cualquiera que necesite mantener el volumen bajo). El responsable de producto de YouTube Liat Kaver, que es sordo, afirma: “Para las personas como yo, que necesitamos adaptaciones en algunas situaciones, el aprendizaje automático nos ofrece la misma independencia que tiene el resto de la gente”.

De hecho, el proyecto de YouTube no es el único que intenta generar nuevas herramientas de accesibilidad mediante la potencia cada vez mayor y el carácter práctico del aprendizaje automático. La industria de la computación mejorado la capacidad de interpretar imágenes, textos o sonidos debido a los posibles beneficios en áreas como la publicidad, las búsquedas y la computación en la nube. Pero el software capaz de entender el mundo tiene aplicaciones que van mucho más allá de eso.

El año pasado, Facebook lanzó una prestación que utiliza los avances de la empresa en reconocimiento de imágenes para generar descripciones de las fotos que publican los amigos de un usuario, por ejemplo. Y unos investigadores de IBM están empleando software de procesamiento del lenguaje desarrollado bajo el proyecto Watson para elaborar una herramienta llamada Content Clarifier (Aclarador de contenidos) para ayudar a la gente con discapacidades cognitivas o mentales como el autismo y la demencia. Puede reemplazar giros lingüísticos como “un resfriado de caballo” con términos más literales y limpiar o dividir frases más largas con múltiples cláusulas y lenguaje indirecto.

La Universidad de Massachusetts en Boston (EEUU) está ayudando a probar este sistema en personas con problemas de lectura o discapacidades cognitivas. El investigador de IBM Will Scott, que colabora en el proyecto, dice que la empresa está hablando con una organización que ayuda a alumnos de secundaria con autismo a realizar la transición a la vida universitaria. El objetivo es probar el sistema como estrategia para ayudarles a entender los documentos administrativos y educativos. Scott detalla: “Antes no existían la potencia computacional ni los algoritmos y servicios basados en la nube como Watson para ejecutar este tipo de cosas”.

La investigadora de la Universidad de Lovaina (Bélgica) Ineke Schuurman afirma el desarrollo de nuevas herramientas de accesibilidad es muy importante, ya que puede impedir que algunos colectivos desaventajados se queden rezagados mientras la sociedad aumenta su dependencia de ordenadores y dispositivos móviles.

Schuurman es una de las responsables de un proyecto de la Unión Europea que está probando un software de simplificación propio para personas con discapacidades intelectuales. La tecnología ha sido integrada en apps que se conectan con Gmail y redes sociales como Facebook. “La gente con discapacidades intelectuales, o cualquier otra, querrá hacer lo mismo que hacen sus amigos y hermanos, utilizar smartphones, tabletas y redes sociales“, señala.

Austin Lubetkin, que tiene un trastorno del espectro autista, ha colaborado con la organización sin ánimo de lucro Artists with Autism para ayudar a otros pacientes a volverse más independientes. Celebra las investigaciones como la de IBM, pero dice que será un reto asegurarse de que las herramientas funcionan bien. Un algoritmo de aprendizaje automático que recomienda una película que al final resulta decepcionante es una cosa; un error que lleve al usuario a malinterpretar a un amigo es otra.

Aun así, Lubetkin, que trabaja en una start-up mientras cursa una licenciatura universitaria, es optimista y cree que el aprendizaje automático ofrecerá nuevas oportunidades a personas con discapacidades durante los próximos años. Recientemente se basó en una tecnología de reconocimiento de imágenes de la start-up Clarify para prototipar una app de navegación que ofrece indicaciones en forma de puntos de referencia, inspirada por su propia lucha para interpretar la información en formato de texto y diagramas de las apps convencionales mientras conducía. La experta concluye: “Sinceramente, la inteligencia artificial puede nivelar el campo de juego”.

Fuente: technologyreview.es