Christian Peñaloza es uno de los científicos menores de 35 años más innovadores del mundo por crear un sistema de ayuda a las personas con parálisis a mover aparatos con la mente.

No toda su vida destacó en las ciencias. “Recuerdo que en la primaria no era muy buen estudiante, incluso estuve a punto de repetir un año escolar”, dice.

Sin embargo, una vez en Tijuana su hermana lo motivó a esforzarse. Christian empezó a destacar en matemáticas, física y química, pero no se le daba el inglés.

CUESTIÓN DE TIEMPO

Aunque Christian destacaba en ciencias, no hablar inglés casi le cierra las puertas. Cuando entró a la preparatoria, su papá le dijo que podía hacer el esfuerzo de pagarle una escuela en Estados Unidos.

“Para mi papá era un sueño que alguno de sus hijos estudiara en Estados Unidos. Mi abuelo fue campesino en Tultepec, Estado de México y después fue indocumentado en Estados Unidos”, recuerda.

Hizo los exámenes de admisión en los que debía demostrar que sabía matemáticas e inglés. “El examen de matemáticas fue muy fácil pero el de inglés no lo pude pasar”.

El director de la preparatoria para la que había aplicado se sorprendió de la capacidad de Christian para las matemáticas y por otro lado, de su deficiencia en inglés.

Miró a Christian y le preguntó en inglés si entendía cuando le hablaba. Christian movió la cabeza afirmativamente.

¿Qué es lo que necesitas para pasar el examen de inglés?, le preguntó. Christian sólo supo responder “time”. El director dejó que Christian repitiera el examen sin cronómetro y logró aprobar.

Desde entonces, todas sus mañanas consistían en esperar formado en el cruce fronterizo de San Isidro para ir a una escuela que, por ser religiosa, casi no tenía latinos en sus aulas.

LOS ROBOTS QUE AYUDAN A LOS HUMANOS

Después de la preparatoria, Christian estudió ingeniería en sistemas en la Universidad de San Diego y para su proyecto final diseñó un robot que no dependía de las órdenes de humanos para funcionar porque contaba con inteligencia propia.

Recordó que a los 15 años su hermana le regaló un robot de juguete que se manejaba a control remoto. Christian imaginó que algún día, los robots ayudarían a las personas en las tareas de la casa o a cuidar enfermos.

Después estudió la maestría en Osaka, Japón, donde estudió neurociencias y robótica, persiguiendo la visión que tenía desde los 15 años sobre los robots que ayudan a las personas.

Pero fue hasta el doctorado, también en Japón, que pudo poner su visión en práctica. Ahí descubrió cómo los pacientes con enfermedades neurodegenerativas pueden mover objetos con la mente, aprovechando los avances de la tecnología.

Se dio cuenta de que esa tecnología agota mentalmente a los pacientes porque tienen que estar muy concentrados en cómo dar órdenes a una máquina para que sea controlada por ellos.

Christian quiso resolver el problema del agotamiento mental y diseñó un sistema que memoriza las antiguas órdenes del paciente para que éste ya no tenga que volver a pensarlas la próxima vez.

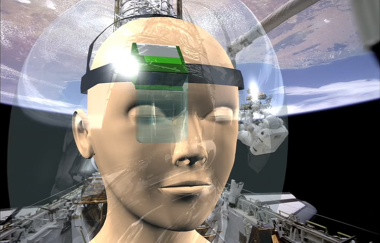

El sistema incluye una gorra con sensores para el paciente, que detecta las señales del cerebro; una computadora que interpreta las señales y ejecuta órdenes; y sensores en los aparatos que el paciente necesita controlar.

CONTROLAR APARATOS CON LA MENTE

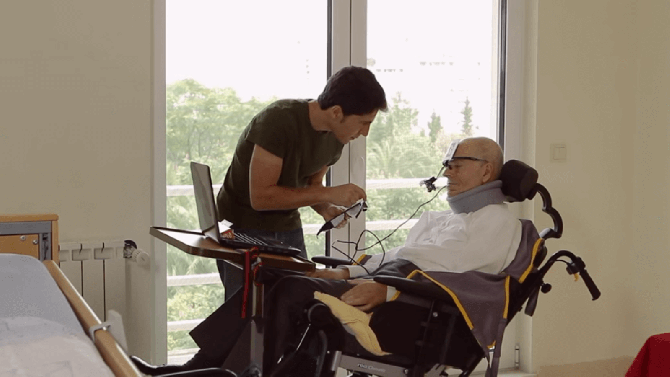

El sistema que Christian diseñó ayuda a que las personas con parálisis motrices puedan hacer tareas sencillas como encender la luz o conectar la calefacción en sus casas usando la mente.

De acuerdo con datos del Inegi, casi 6 millones de mexicanos tienen algún tipo de discapacidad. La mitad tienen alguna discapacidad para caminar o moverse, siendo la más común en el país.

Muchos pacientes rechazan este tipo de tecnología por el cansancio que les provoca, así que Christian “entrenó” al dispositivo para memorizar las acciones del usuario y la próxima vez que requiere algo, se puede adelantar para que la persona no tenga que pensarlas.

El desarrollo de este tipo de interfaces comenzó con los primeros sistemas que captaban la actividad cerebral, a principios del siglo XX. Sin embargo, hasta la década de los 70 se comenzó a investigar el uso de las ondas cerebrales para comunicarse con dispositivos y las primeras prótesis neuronales se desarrollaron en 1990 para pacientes con problemas de audición, vista o movilidad.

Una interfaz cerebro-máquina sirve para comunicar a una persona con una máquina sin que requiera ningún tipo de movimiento de articulaciones. Funciona a partir de una señal cerebral del usuario hacia un dispositivo que se encarga de ejecutar una determinada acción. Después, esos estímulos cerebrales deben “traducirse” en comandos comprensibles para la máquina.

Por ejemplo, cuando el usuario está cansado y quiere apagar la luz, el sistema detecta ese estado cognitivo y apaga la luz. Además guarda la acción para que la próxima vez lo haga automáticamente; y si el sistema se equivoca, puede aprender de sus errores.

Este avance convirtió a Christian en uno de los ganadores del premio “Innovadores Menores de 35 años” en 2016, otorgado por el Instituto Tecnológico de Massachusetts, una de las mejores universidades del mundo. En esa misma ceremonia se le reconoció como el “Innovador del año 2016”.

DOS CAMINOS A ELEGIR

En 2008 tuvo la oportunidad de trabajar por un tiempo en Canadá para una compañía de ingeniería.

Al final le ofrecieron quedarse a trabajar pero ese mismo día le hablaron de una compañía en Japón para hacer un internado en ese país.

No sabía qué elegir. Por un lado tenía el camino seguro que era aceptar el empleo en Canadá y por otro, ir a un internado de cuatro meses en Japón sin la certeza de quedarse a trabajar allá.

Sus amigos le dijeron que se fuera por lo seguro, que aceptara el empleo en Canadá. Christian recordó algo que su papá siempre le decía. Que si él quería dejar todo atrás como cuando se fue a estudiar a Estados Unidos, siguiera a su corazón y él lo apoyaría.

EL PROYECTO EN MÉXICO

Christian dejó todo atrás, como cuando se formaba durante horas para cruzar la frontera, esta vez para ir a Asia y superar nuevas fronteras: la del idioma y la cultura japonesa.

Después de un tiempo quiso especializarse en robótica e inteligencia artificial, pero no tenía manera de quedarse a estudiar en Japón porque el internado estaba por terminar.

Recordó que dos años antes había aplicado para una beca de maestría otorgada por la embajada de Japón en México. Sin embargo, para que la embajada japonesa revisara su aplicación tenía que pasar por el filtro de la Secretaría de Relaciones Exteriores (SRE).

La SRE rechazó la aplicación de Christian. Esta vez, dos años después del rechazo, Christian estaba en una mejor situación financiera gracias a los ahorros que consiguió trabajando y al apoyo de sus padres. Pensó que con eso podía pagarse la maestría.

Sin embargo, en el último semestre de la maestría sus ahorros comenzaron a agotarse y sus padres no pudieron apoyarlo más por problemas económicos.

Christian pidió empleo a un restaurante de comida japonesa. Empezó trabajando limpiando los sartenes y posteriormente le enseñaron a cocinar.

“Estar parado durante horas detrás de un mostrador con un sartén caliente, me enseñó a valorar el trabajo que personas sin otra opción tienen que enfrentar día a día”, recuerda.

Un profesor lo encontró dormido a media clase y Christian confesó que había encontrado un trabajo para pagarse la maestría.

El profesor le dijo que dejara de trabajar y que él lo contrataría como su asistente de laboratorio. Así, Christian pudo terminar con éxito su maestría y después continuó con el doctorado en la misma universidad, esta vez con una beca y sin pasar por el filtro de la SRE.

Christian abrió una empresa en Tijuana llamada Mirai Innovation. Piensa que se puede utilizar todo el potencial de los ingenieros mexicanos para realizar proyectos que impacten positivamente a los mexicanos.

En México están perfeccionando la tecnología que Christian desarrolló inicialmente en Asia. Allá, la validación de su proyecto fue muy costosa y difícil de usar, por lo que están buscando una forma más barata para traerlo al país.

Esta tecnología también se está usando para detectar cuando un conductor se queda dormido y evitar que sufra un accidente. De inmediato emite una alarma y envía una señal para disminuir la velocidad. También la pueden usar trabajadores de maquiladoras para evitar accidentes en el trabajo.

En México cada hora se registran casi 50 accidentes laborales, de acuerdo con las estadísticas del Instituto Mexicano del Seguro Social.

“Mi visión es poder utilizar el potencial de los ingenieros mexicanos para realizar proyectos en salud, educación, seguridad, etc. que impacten a millones de personas”, dice Christian.

Fuente:www.elsiglodedurango.com.mx

Fuente: colimanoticias.com